有偿招募在校大学生49人,其中男生21人,女生28人,年龄18~25岁,平均年龄为20.96岁。所有被试身体健康,视力或矫正视力正常,均为右利手。

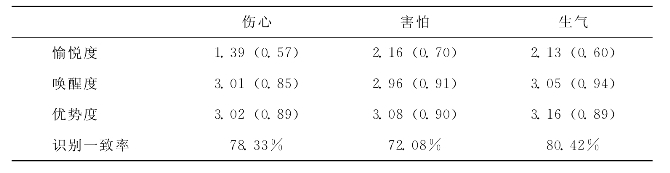

从某公司工作人员中招募8名模特(4名男性,4名女性,与参与本研究的所有被试均不相识),让他们分别表演3种(伤心的、害怕的、生气的)表情。使用佳能SX210的1400万像素的相机,对拍摄模式进行统一调试。以白墙为背景,表演者取正坐位,距墙0.2米、距相机1米,以相机聚焦时光线聚集在脸部鼻梁正中时的位置定位相机高度。并由2名心理学工作者就表情的内在情绪含义、表情特征对表演者进行解释说明,并结合不同的情境和经历诱发其情绪。所有照片均由同一人在同一实验室和同样条件下完成拍摄,图片的大小均标准化为256×192像素。初次得到表情图片48张。为了检验图片材料的效度,请40名心理学专业的本科生(其中男生17名,女生23名)对这些面孔图片进行评定。按照Osgood等的情绪维度理论,从愉悦度(valence)、唤醒度(arousal)和优势度(dominance)[5]三个方面对表情图片进行5点量表式评分(刘潇楠、许翱翔、周仁来,2009),评分采用自我评价模式(self-assessment manikin,简称SAM)(白露、马慧、黄宇霞、罗跃嘉,2005),评定等级为1到5,1表示低值,5表示高值。然后根据他们评价的结果从中选取较具代表性的图片24张,这24张图片的评定结果见表11-4。并借鉴王妍和罗跃嘉(2005)的评定方法,请30名大学生(男生14名,女生16名)对这24张图片的情绪类别进行识别,图片情绪类别的识别一致率均超过了70%(见表11-4),表明这些表情图片具有一致性和代表性(王妍、罗跃嘉,2005;顾莉萍等,2009)。

表11-4 各种负性表情图片愉悦度、唤醒度和优势度的平均值(标准差)及识别一致率(www.daowen.com)

为了提高表情图片的生态效度,利用Magic Morph软件得到各种表情下44%和88%强度的图片(Barrett、Bliss-Moreau,2009;朱春燕、汪凯、陶睿、庞礴,2010),0%代表中性表情,100%代表表演的表情。考虑到东西方的文化差异,西方人情绪表现夸张,而中国人深受儒家为代表的行为规范和道德标准强调的不苟言笑、喜怒不形于色的影响而崇尚情绪抑制,情绪表现较为内向、含蓄(孟昭兰,2005),所以本研究中使用情绪强度88%的表情图片作为目标表情图片。

以40名心理学专业的本科生(其中男生17名,女生23名)为被试,对情绪的情境归因进行了开放式的问卷调查。再根据情境句子的频率,从每种情绪的情境归因句子中,选出8个频率高的情境句子。这8个情境句子随机地与情绪图片进行配对。采用2(目标性别:男、女)×3(情绪:伤心、害怕、生气)×2(被试性别:男、女)混合实验设计,其中被试性别是组间变量,其他因素均为组内变量。因变量是性格归因的平均频次、再认正确率。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。