你能想象当你在iPhone(苹果手机)上看到股价暴跌,iPhone 问你为什么不高兴,会是怎样一种感觉吗?你的面部表情是情绪的窗口,深度学习现在已经可以探进这个窗口了。传统上,人们认为认知和情绪是大脑两个独立的功能。一般认为,认知是皮层功能(cortical function),而情绪是皮层下的功能(subcortical function)。事实上,有些皮层下结构可以调节情绪状态,比如杏仁核(amygdala)。当情绪水平很高,特别是感到恐惧的时候,杏仁核就会起作用,但这些结构与大脑皮层有强烈的相互作用。例如,在社交互动中,杏仁核的参与会增强人脑对该事件的记忆。认知和情绪是彼此交织的。

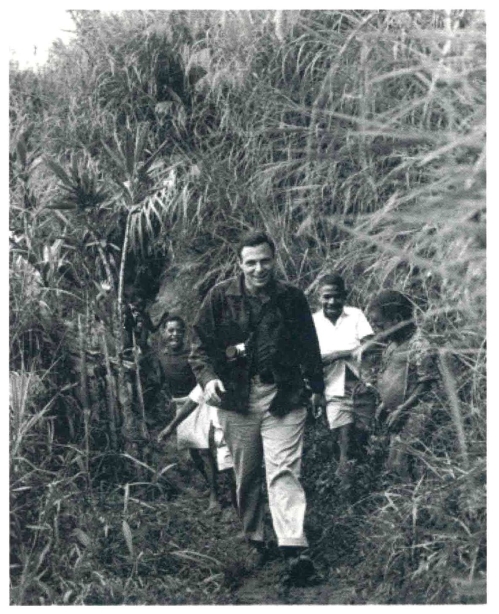

在20世纪90年代,我与加州大学旧金山分校的心理学家保罗·艾克曼(Paul Ekman)(见图12-5)有过合作。艾克曼是世界著名的面部表情专家,是美剧《别对我撒谎》(Lie to Me)系列中卡尔·莱特曼(Cal Lightman)博士在真实世界中的原型,但他本人比剧中的卡尔要和善很多。艾克曼曾去过巴布亚新几内亚,试图了解前工业时代的文化是否像我们一样,能够做出情绪化的面部表情。他在研究过的所有人类社会中发现了六种普遍的情感表达:快乐、悲伤、愤怒、惊讶、恐惧和厌恶。从那以后,其他常见的面部表情也被提取了出来,但人们在对这些表情的理解上并没有达成共识。有些表达,如恐惧,在一些孤立的社会中有着不同的解释。

1992 年,艾克曼和我组织了一个由美国国家科学基金会(NSF)赞助的关于面部表情理解的规划研讨会。17 在那个时期,要获得对面部表情研究的资金困难重重。我们的研讨会将神经科学、电子工程和计算机视觉等方面的研究人员,连同心理学家聚集到了一起,为表情分析领域揭开了新篇章。这件事对我来说是一个启示,尽管面部表情的分析在科学、医学和经济等诸多领域都扮演着重要角色,但其重要性却一直被基金机构所忽视。

图12-5 1967 年,保罗·艾克曼和巴布亚新几内亚原住民。他找到了6种常见的面部情感表达的证据,包括快乐、悲伤、愤怒、惊讶、恐惧和厌恶。保罗曾为美剧《别对我撒谎》提供咨询,以保证每一集的内容有科学依据。卡尔·莱特曼博士的角色大致上是以艾克曼为原型塑造出来的。图片来源:保罗·艾克曼。

艾克曼开发了面部动作编码系统(Facial Action Coding System,以下简称FACS)来监控面部44 块肌肉的状态。由艾克曼培训的FACS 专家需要花费一个小时来标记长度为一分钟的视频,每次标记一帧。面部表情是动态的,可以延续若干秒,但是艾克曼发现,有些表情只持续了几帧。这些“微表情”泄露了大脑被抑制的情感状态,常常能说明,有时还会揭示无意识的情绪反应。例如,在婚姻咨询环节中出现的细微的厌恶表情,就是一个预示婚姻会失败的可靠的信号。18(https://www.daowen.com)

在20 世纪90 年代,我们使用了一些演员的视频录像来训练反向传播神经网络,对FACS 进行自动化。这些训练有素的演员可以像艾克曼那样控制脸上的每一块肌肉。1999 年,由我的研究生玛丽安·斯图尔特-巴特利特(Marian Stewart-Bartlett,见图12-6)利用反向传播训练的网络,在实验室识别面部表情的准确率达到了96%,前提是要具备完美的照明,周正的面部角度,以及对视频进行手动时间分割。19这个网络的识别效果很不错,于是1999年4月5日,玛丽安和我在黛安·索耶(Diane Sawyer)主持的《早安美国》(Good Morning America)节目中向公众展示了这一成果。在成为加州大学圣迭戈分校神经计算研究所的一名教师后,玛丽安接着又开发了计算机表情识别工具箱(Computer Expression Recognition Toolbox,以下简称CERT)。20随着计算机的速度变得越来越快,CERT已经能够进行实时分析,可以标记视频流中不断变化的人类面部表情。

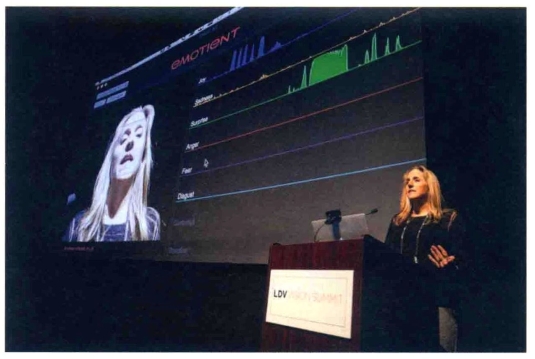

图12-6 正在演示面部表情分析技术的玛丽安·斯图尔特-巴特利特。时间轴上显示的是深度学习网络的输出,正在识别面部表情中快乐、悲伤、惊讶、恐惧、愤怒和厌恶的情绪。图片来源:玛丽安·斯图尔特-巴特利特,Robert Wright/LDV Vision Summit 2015。

2012 年,玛丽安和哈维尔·莫维兰将面部表情的自动分析技术商业化,创立了一家名为“Emotient”的公司。保罗·艾克曼和我为这家公司担任科学顾问。Emotient 开发的深度学习网络能够以96% 的准确率,在各种不同的照明条件下,利用非正面面部信息实时地对自然行为做出判断。在Emotient 的一个演示中,其网络在几分钟内就检测到唐纳德·特朗普(Donald Trump)在共和党的首场初选辩论中,对一个焦点小组[1]的情绪影响最大。相比之下,民意调查人员花了数天时间才得出了同样的结论,专家们更是在几个月之后才认识到,情感投入是争取到选民的关键。焦点小组中最强烈的面部表情是愉悦,其次是恐惧。此外,Emotient 的深度学习网络在尼尔森收视率(Nielsen ratings)调查结果发布前的几个月,就预测到了哪些电视剧将大热。Emotient 于2016 年1 月被苹果公司收购,玛丽安和哈维尔现在均在苹果公司任职。

在不久的将来,你的iPhone 可能不仅会问你为什么不高兴,还可能帮助你冷静下来。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。