我和杰弗里·辛顿(见图4-1)在1979 年他组织的一次研讨会上相识。因为对神经网络模型的未来抱有相似的信念,我们很快就成了朋友。后来我们合作研究出了一种新型神经网络模型,叫作“玻尔兹曼机”(Boltzmann machine)(将在第7章中进行讨论),并就此打破了阻碍一代人研究多层网络模型的僵局。

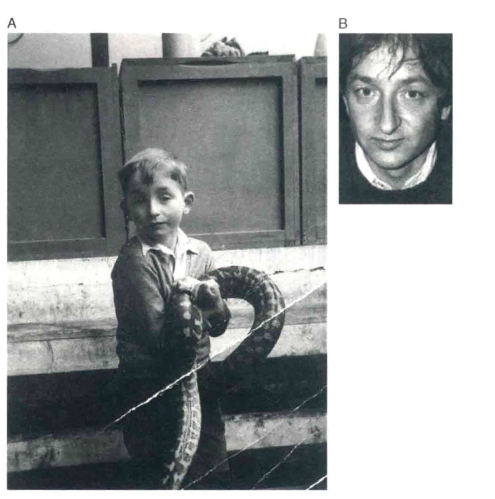

图4-1 (A)童年时期的杰弗里·埃弗里斯特·辛顿(Geoffrey Everest Hinton)。他的中间名来自一个亲戚乔治·埃弗里斯特(George Everest)。乔治曾在印度负责勘测工作,并想出了测量世界上最高峰高度的方法,后来该峰以他的名字被命名为Everest(即珠穆朗玛峰)。(B)1979 年的辛顿。这两张照片的拍摄时间间隔了15 年。图片来源:杰弗里·辛顿。

每隔几年,我都会接到杰弗里的一个电话,第一句都是“我想清楚大脑是怎么工作的了”。每一次,他都会告诉我一个巧妙的改进神经网络模型的新方案。尝试了多种方案并进行了若干次的改进后,利用多层神经网络的深度学习才在手机中的语音识别和识别照片中的对象等方面达到了与人类相近的水平。公众几年前才意识到深度学习的这些能力,虽然现在这些已经是众所周知的了,但这一过程却花费了相当长的时间。

杰弗里在剑桥大学获得了心理学学士学位,并在爱丁堡大学获得了人工智能博士学位。他的论文导师是克里斯托弗·朗古特-希金斯(Christopher Longuet-Higgins)。希金斯是一位杰出的化学家,他发明了一种早期的联想记忆网络模型。那时,实现人工智能的主流方式是基于使用符号、逻辑和规则来编写智能行为的程序;认知心理学家已经采用这种方法来理解人类的认知能力,尤其是语言。而那时的杰弗里却在逆流而行。没有人能预见到他有朝一日会搞清楚大脑——或者至少类似大脑的某种东西——的工作原理。他的讲座非常引人入胜,他能够清楚地解释抽象的数学概念,连没有太多数学基础的人都能够理解和掌握。他的机智和不失谦逊的幽默感令人倾倒。杰弗里天生也有着激进的一面,特别是当涉及大脑的话题时。(www.daowen.com)

我们第一次见面时,杰弗里还是加州大学圣迭戈分校(UCSD)的一名博士后研究员,在由大卫·鲁姆哈特(David Rumelhart)和詹姆斯·麦克莱兰(James McClelland)领导的并行分布式处理(Parallel Distributed Processing,PDP)实验室工作。杰弗里坚信,将由简单处理单元构成的网络、并行工作和从样本中学习相结合,是理解认知的更好的方式。当时PDP 实验室正在探索如何以分布在网络中的大量节点活动的形式来理解文字和语言,而杰弗里是其中的核心人物。

认知科学中理解语言的传统方法是基于符号表征。例如,“杯子”这个词是代表杯子概念的符号,不是特指某个杯子,而是指所有杯子。符号的美妙之处在于,它们让我们能够对复杂的概念进行压缩,并运用它们;而符号的问题在于,这种过分概括的表达形式使其很难在现实世界中被精确地描述出来——在现实世界中,杯子的样式、形状和尺寸有着无数种可能。虽然我们大多数人在看到杯子的时候都能很快认出它是什么,但没有一个逻辑程序能够清楚地指认哪个东西是杯子,哪个不是,也无法识别出图片中的杯子。正义、和平之类的抽象概念更会让一个计算机程序产生困惑。另一种方法是,通过大量神经元上的活动模式来表示杯子,如此一来就可以捕捉概念之间的相似和差异点。这赋予了符号可以反映其含义的丰富的内部结构。问题在于,在1980 年,还没有人知道如何创建这些内部表征。

在20 世纪80 年代,相信网络模型能够模仿智能行为的人并不只有我和杰弗里。全世界有一些研究人员,虽然大多都在独自耕耘,但与我们有着共同的信念,坚持不懈地开发着专门的网络模型。他们当中的一位,克里斯托弗·冯·德·马尔斯伯格(Christoph von der Malsburg),开发了一种模式识别模型,将发射脉冲的人造神经元连接在一起,1 并证明了这种方法可以识别图像中的人脸。2 另外,大阪大学的福岛邦彦(Kunihiko Fukushima)发明了神经认知机(Neocognitron),3一个基于视觉系统架构的多层网络模型,它使用了卷积滤波器和简单形式的赫布可塑性(Hebbian plasticity),这也是深度学习网络的一个直接的前身。第三个例子是赫尔辛基大学的电气工程师戴沃·科霍宁(Teuvo Kohonen),他开发了一个自组织网络,可以学习将相似的输入通过不同的处理单元聚类到二维映射中(例如可以用来代表不同的语音),相似的输入能够激活输出空间的相邻区域。4 科霍宁网络模型的一个主要优点是,它不需要对每个输入的类别进行标记(通过生成标记来训练监督网络的花费十分高昂)。科霍宁的箭袋中只有一支箭,但却被打磨得非常精良。

在加州大学洛杉矶分校的朱迪亚·珀尔(Judea Pearl)引入了将网络中的结点用概率联系起来的信念网络,比如草地变湿,是因为喷水器打开了的概率,或者因为下雨了的概率。5 这是一个很有前景的将概率网络系统化的早期尝试。虽然珀尔的网络模型是一个可以用于追踪世间因果关系的强大框架,但手动分配所有所需概率已经被证明是不切实际的。能够自动找到概率的学习算法依然有待突破(会在本书第二部分讨论)。

上述几个例子和其他基于网络的模型都有一个共同的致命缺陷:它们都不足以解决现实世界中的问题。而且,开发它们的先驱者很少与他人合作,要取得进展就更加举步维艰。如此一来,麻省理工学院、斯坦福大学和卡内基-梅隆大学的一流人工智能研究中心里,就没有多少人看好神经网络了。基于规则的符号处理获得了大部分资金支持,并完成了大部分的相关研究工作。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。