1.视线追踪意义

视线追踪是一个比较新的研究方向,它具有非常广泛的应用范围及很大的应用价值。在视线追踪技术的基础上,可开发出很先进的人机交互系统。计算机将能够根据人的视线所落在屏幕上的位置,判断出人想要进行的操作,从而自动执行,而不再需要鼠标的介入。将视线用于人机交互可带来直接性、自然性和双向性等优点。对于可视形式的目标选择和操纵任务,任何其他通道(如手、头)都是在视觉通道指导下进行的,即用户首先扫描定位到感兴趣对象,再引导其他通道的选择或操纵动作。视线(Visual Line)反映人的注意方向,这是将其用作计算机输入的前提。视觉交互兼顾了输入输出双向性特点,即视线所指通常反映用户感兴趣的对象,而传统手动输入装置是根据视觉指导进行操作的。可以想象,避开其他通道及交互装置而直接检测视线输入方向和位置来进行交互便具有直接性和自然性特点。另外,在交通安全中,追踪驾驶员的视线能够知道这个驾驶员是否走神了,从而及时提醒他,避免危险的发生,因而具有极大的应用价值。

2.眼睛运动的特点

眼睛看物体的过程是转动眼球使物体出现在视网膜的中央凹中,因此眼球的位置指示了我们注视场景中的特定区域。视线运动通常表现为点到点的跳跃式扫描(Saccade),而并非平滑移动(这只在追踪运动物体时才会发生)。例如,阅读时人眼在一行中通常包含4~7个跳动-定位动作,一般注视持续200~600ms,只是我们通常并未在意。但是眼球为看清物体总是需要不停地做轻微的抖动,其幅度一般小于1°。只有在追随视野中移动的物体时,才会出现平滑的眼动而不是突然的扫视。因此,利用视线进行书写和画图这样精细的动作是不可行的。换言之,不能将眼动产生的轨迹直接利用于人机交互。另一类眼动如眼球震颤、汇聚、扭转视线跟踪技术及装置有强迫式与非强迫式、穿戴式与非穿戴式和接触式与非接触式之分;有的系统要求用户的头静止不动,对人机对话则没有显著意义。

3.现有的视线跟踪设备

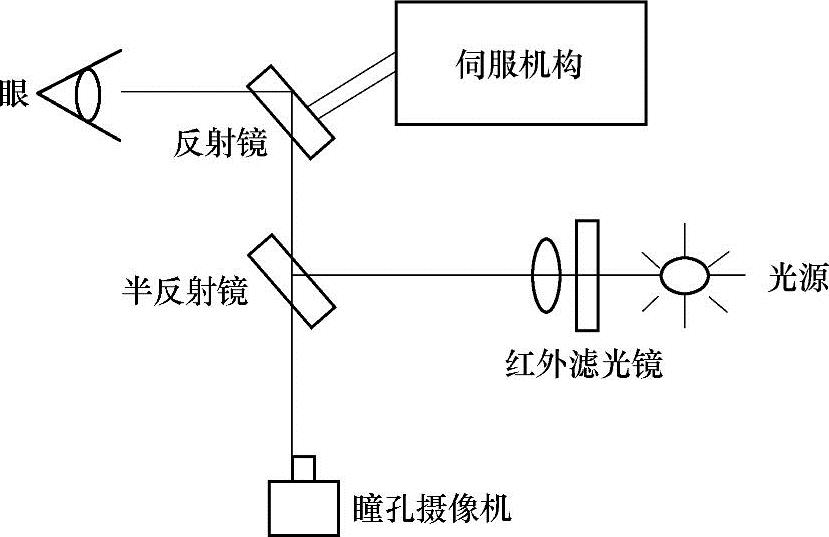

现在已经有一些可用于实现跟踪的设备。这些设备通常都需要有一些特殊硬件的支持。视线跟踪装置的识别精度可从0.1°至1°或2°不等,制造成本也有巨大差异。在价格、精度与方便性等因素之间做出权衡是一件困难的事情,例如视线跟踪精度与对用户的限制和干扰就是一对尖锐的矛盾。由Applied Science Laboratories制造的Model 3250R视线跟踪器允许用户的头运动,是一种非接触式远距离视线跟踪系统。该系统能同时跟踪角膜反射及瞳孔轮廓形状,视线可根据两者之间的关系计算得到。其工作原理如下:光源发出的光线经红外滤光镜过滤后只有红外线可以通过;经过半反射镜后,部分红外线到达反射镜;再经反射镜反射到达眼球,眼球对红外线的反射光经同一反射镜反射到达半反射镜;其中有部分红外线通过半反射镜到达瞳孔摄像机,从而得到眼球的完整图像,再经软件处理后获得视线运动的数据。图5-31中,瞳孔摄像机与光照系统经半透镜在同一坐标轴上工作,伺服机构控制反射镜用于补偿用户头的运动。

4.视线追踪算法

上面提到的视线追踪方法用到了特殊的硬件,即红外线光源和高精度的瞳孔摄像机,在价格上较为昂贵。再者,红外线直接照射眼睛可能会对眼睛产生伤害,所以这些视线跟踪设备都不是理想的设备。理想的视线跟踪设备应该既不需要特殊设备的支持,也不会对人体产生伤害。也就是说,应该设计一套主要依靠软件来实现视线跟踪的视线跟踪设备。本节就是以这样一个目标为方向,想要设计没有特殊硬件支撑及对人体无伤害的视线跟踪系统。

图5-31 一种远距离实现跟踪系统原理图(https://www.daowen.com)

在上面工作的基础上,提出了一种利用眼睛瞳孔和眼角的相对位置来检测人的视线方向的方法,取得了一定的效果。此方法的关键在于找出瞳孔和眼白的相对位置。本节在找到了眼睛区域以后,在这一区域进行了像素的局部搜索。用一个全局变量num记录黑色像素点数,用xnum和ynum分别记录黑色像素点x坐标和y坐标。取这些黑色像素点坐标的平均值,就知道了瞳孔中心的位置,这样一来,就可以根据瞳孔与眼眶的相对位置来大致判断视线的方向。在某些情况下,检测到的眼眶大小可能与实际有些偏差,这种情况下,可以通过再做一次眼睛区域的白色像素点的搜索来找眼白的重心点,再通过判断瞳孔与眼白重心点的相对位置来判断视线的方向。其程序流程如图5-32所示。图5-33中给出了几幅效果图。

图5-32 视线跟踪系统流程

图5-33 视线跟踪效果图

图5-33 视线跟踪效果图(续)

5.小结

本节所采用的视线跟踪方法简单,易于实现,在条件(主要是光照)较好时,能达到一定的效果,但对于一般的场景,尤其是有光照明显变化的场景,由于人脸检测及眼睛定位的不稳定性,该技术方法还有待于进一步研究。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。