1.神经网络的模型

神经网络由神经元来模仿单个的神经细胞。其中,xi表示外部输入,f为输出,圆表示神经元的细胞体,θ为阈值,ωi表式连接权植。图6-1为一个神经元的结构。

图6-1 一个神经元的结构

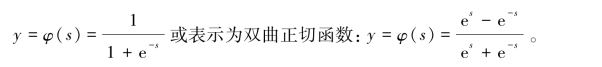

输出f取决于转移函数φ![]() ,常用的转移函数有三种,根据具体的应用和网络模型进行选择。

,常用的转移函数有三种,根据具体的应用和网络模型进行选择。

神经网络具有以下优点:

(1)可以充分逼近任意复杂的非线性关系。

(2)具有很强的鲁棒性和容错性。

(3)并行处理方法,使得计算快速。

(4)可以处理不确定或不知道的系统,因神经网络具有自学习和自适应能力,可根据一定的学习算法自动地从训练实例中学习。

(5)具有很强的信息综合能力,能同时处理定量和定性的信息,能很好地协调多种输入信息关系,适用于多信息融合和多媒体技术。

以下是几种典型的神经网络拓扑结构:

1)单层网络

最简单的网络是把一组几个节点形成一层,如图6-2所示。图中,左边的小圆圈只起分配输入信号的作用,没有计算作用,所以不看作网络的一层,右边用大圆圈表示的一组节点则是网络的一层。输入信号可表示为行向量X=(x1,x2,…,xN),其中每一分量通过加权连接到各节点。每一节点均可产生一个输入的加权和。实际的人工神经网络和生物神经网络中有些连接可能不存在,为了更一般化,采用全连接。

图6-2 单层人工神经网络

权值用于模拟神经元之间的连接强度,而通过学习得到的信息或知识就“存储”在权值中,并以权值表现出来。

2)多层网络

将单层网络进行级联,一层的输出作为下一层的输入,即可得到多层网络。在多层网络中,同样地,接收输入信号的输入层不计入网络的层数。产生输出信号的层为输出层,除此之外的层称为隐层。在多层网络中,层间的转移函数是非线性的。

图6-3 多层人工神经网络

3)回归型网络(反馈型网络)

一般来说,凡包含反馈连接的网络均称为回归型网络,或称反馈型网络。反馈连接就是一层的输出通过连接权回送到同一层或前一层的输入。

2.神经网络的学习算法(https://www.daowen.com)

分为三大类:有教师学习(也称为监督学习、有指导的学习)、无教师学习(也称为非监督学习、无指导的学习)和增强(或分级)学习。

神经网络的学习过程如图6-4所示。

图6-4 神经网络的学习过程

有教师学习中,对于每一个输入向量xk,有与之相对应的目标或期望输出dk时,就可以构成训练组(xk,dk),k=1,2,…,当加入一个输入向量时,算出网络的实际输出yk,并与目标输出dk相比较,根据其误差δk,用某种算法或规则来调整(训练)网络的权值。这样,不断地加入输入向量,使网络的实际输出越来越接近于目标输出,直到所有训练组的误差都达到可以接受的程度时,权值的训练即告结束,目标向量起到了教师的作用。有教师的学习过程如图6-5所示。

在无教师的学习中,根据网络的输入和自身的“经历”来调整网络的权值和偏置值,它没有目标输出。大多数这种类型的算法都是要完成某种聚类操作,学会将输入模式进行分类。这种网络的学习评价标准是隐含于网络的内部的。无教师的学习过程如图6-6所示。

图6-5 有教师的学习过程

图6-6 无教师的学习过程

转移函数(激励函数)描述了生物神经元的转移特性,可以是s的线性或非线性函数,可以用特定的转移函数满足神经元要解决的特定问题。常用的有:

1)阈值型

输出为±1或(0,1)两种状态,有时称为硬限幅函数。

2)分段线性型

神经元的输入输出特性满足一定的区间线性关系。

3)S型

常表示为对数函数,是一种常用的可微激活函数,这样的一个激活函数使得神经网络的输出具有良好的统计解释。

隐层为S型神经元的二层网络是一类实用上非常重要的神经网络,它能以任意精度表示任何连续函数。只要隐层神经元的个数充分多,则隐神经元为S型神经元而输出元为线性元的二层网可任意逼近任何函数。

其重要推论是就分类问题而言,这一网络能以任意精度逼近任何形状的决策边界。因此,这一网络提供了一个万能非线性判别函数。

神经网络的学习规则就是修改神经网络的权值和偏置值的方法和过程(也称这种过程为训练算法)。学习规则的目的是为了训练网络来完成某些工作。

下面我们对一个神经网络的学习进行讨论,假设该网络由S型神经元构成,则选择转移函数为 ,则此网络中第i层第j个输出为

,则此网络中第i层第j个输出为 ,其中

,其中![]()

![]() 为第j-1层的输入向量,

为第j-1层的输入向量, 为相应的权值

为相应的权值![]() 向量

向量![]() 。对权的调节公式为:

。对权的调节公式为:![]() ,通过对权不断地调节,使网络得到训练,从而使网络的实际输出y越来越接近于目标输出d,网络学习结束,实现了我们的目标。在不同的神经网络学习算法中,对

,通过对权不断地调节,使网络得到训练,从而使网络的实际输出y越来越接近于目标输出d,网络学习结束,实现了我们的目标。在不同的神经网络学习算法中,对 的计算方式各不相同。

的计算方式各不相同。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。