一个人工神经网络的拓扑结构确定之后,为了使它具有某种智能特性,还必须有相应的学习方法与之配合。学习方法是人工神经网络研究中的核心问题。人工神经网络的学习问题归根结底就是网络连接权的调整问题。人工神经网络连接权的确定一般有两种方式:一种是通过设计计算确定,即所谓的死记式学习;另一种是网络按一定规则通过学习得到的。

人工神经网络的学习(训练)方法归纳起来有如下几种类型:

1)从学习过程的组织与管理而言有:有监督学习和无监督学习。

2)从学习过程的推理和决策方式而言有:确定性学习、随机学习和模糊学习。

下面重点介绍一些主要学习方法的含义及特点:

1)死记式学习。网络的连接权是根据某种特殊的记忆模式事先设计好的,其值不变。以后当网络输入有关信息时,这种记忆模式就会被回忆起来。

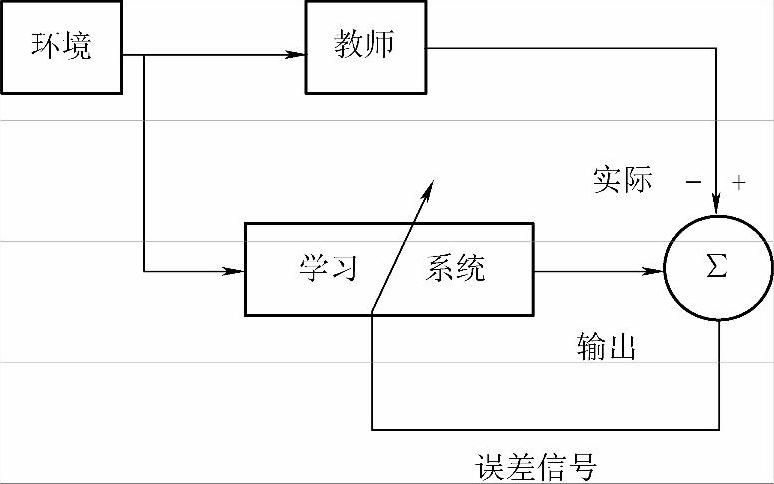

2)有监督学习。在这种学习中,学习的结果,即网络的输出有一个评价的标准,网络将实际输出和评价标准进行比较,由其误差信号决定连接权的调整。评价标准是由外界提示给网络的,相当于有一位知道正确结果的教师示教给网络,故这种学习又称为教师示教学习,其原理如图7-6所示。在这种学习中,网络的连接权常根据δ规则[1]进行调整。

图7-6 有监督学习

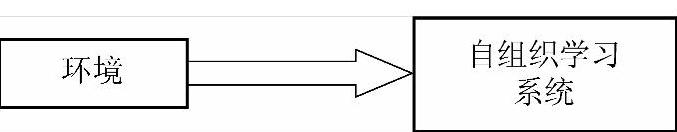

3)无监督学习。无监督学习是一种自组织学习,即网络的学习过程完全是一种自我学习的过程,不存在外部教师的示教,也不存在来自外部环境的反馈指示网络应该输出什么或者是否正确,故又称它为无教师示教学习。其学习过程如图7-7所示。

图7-7 无监督学习

所谓自组织学习,就是网络根据某种规则反复地调整连接权以响应输入模式的激励,直到网络最后形成某种有序状态。也就是说,自组织学习是靠神经元本身对输入模式的不断适应,抽取输入信号的规律。一旦网络显现出输入数据的统计特性,则网络就实现了对输入特征的编码,即把输入特征“记忆”下来。而且在记忆之后,当它再出现时,能把它识别出来。自组织学习能对网络的学习过程进行度量,并优化其中的自由参数。可以认为,这种学习的评价准则隐含于网络内部。神经网络的这种自组织特性来源于其结构的可塑性。在自组织学习中,常用的学习规则有Hebb学习规则和相近学习规则,前者产生自放大作用,后者产生竞争作用。故自组织学习是通过放大、竞争以及协调等作用实现的。输入数据的冗余为神经网络提供了知识。某些知识可以由观测输入数据的统计特征得到。如果没有这种冗余性,则自组织学习就不能发现输入数据中的任何模式或特征,故输入数据的冗余性是自组织学习的必要条件。

无监督学习可以实现主分量分析、聚类、编码以及特征映射等功能。

4)有监督无监督混合学习。有监督学习具有分类精细、准确的特点,但学习过程较慢。无监督学习具有分类灵活、算法简练的优点,但精度不高。如果将两者结合起来,发挥各自的长处,就能形成更为有效的学习方法。

混合学习过程一般是先用无监督学习抽取输入数据的特征,然后将这种内部表示送到有监督学习部分进行处理,以达到输入到输出的某种映射。由于对输入数据进行了预处理,将会使有监督学习及整个学习过程加快。混合学习对某些神经网络是很有效的。(www.daowen.com)

5)无监督竞争学习。竞争学习是无监督学习中的一种重要学习方法,在神经网络中有广泛的应用,例如,在ART和SOFM网络中都采用了这种学习方法。这种学习方法的特点是按某种评价确定竞争层“获胜”神经元。获胜神经元的输出置1,其他皆置0,连接权的调整仅在获胜神经元与输入之间进行,其他皆不变。连接权的调整按相近学习规则计算,即

wij(t+1)=wij(t)+η(t)[xj−wij(t)] (7-6)

式中,xj(j=1,2,…2;,n)为输入信号;η(t)为t时刻的学习速率。

6)无监督Hebb学习。此种学习是在自组织学习中采用Hebb学习规则调整网络的连接权值,以适应输入模式的激励。它是无监督学习中的另一种重要的学习方法,因而在神经网络中有广泛的应用。

7)Boltzmann学习。这是一种随机学习方式。由这种学习构成的算法又称为模拟退火算法。这种学习方式的特点是在工作和学习过程中用概率进行测度。例如,Boltzmann网络在工作过程中,神经元的状态是否更新决定于神经元状态出现为1概率的大小。该概率用下式计算

式中,xi(i=1,2,…,n)为神经元的状态;T为退火温度[2];ui为神经元的内部状态,由下式计算

式中,wij为神经元i与j之间的连接权;θi为阈值。

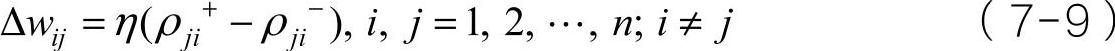

又如Boltzmann网络在进行学习时,神经元i和j之间连接权的调整可表示为

式中,ρji+和ρji−为网络处于某种特定环境下神经元i和j所有可能状态之间的相关矩。Boltzmann学习在优化计算和随机模拟中有重要应用。

8)模糊学习。模糊学习是一种以模拟理论为基础的学习方法。这种学习方法的特点是学习过程用模糊量进行测度,即输入量是经过模糊化后的模糊量。以连接权作为参数的输入与输出映射关系也是一种模糊集合的运算关系。模糊理论与神经网络相结合,发挥各自的长处,在某些情况下其效果比单独用神经网络或模糊系统更好。

9)强化学习。有监督学习是假设对每一个输入模式都有一个正确的“目标”输出,但是有时候只能得到很不具体的信息。例如,只知道输入变化的趋势是正确还是错误。强化学习就是针对这种情况提出的。强化学习可以看成是一类有监督学习,因为它从环境中接受反馈信息。但这种反馈只是一个“是”与“否”的评价信号,所以又称它为“有评判的学习”。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。